What is Transformer Lab?

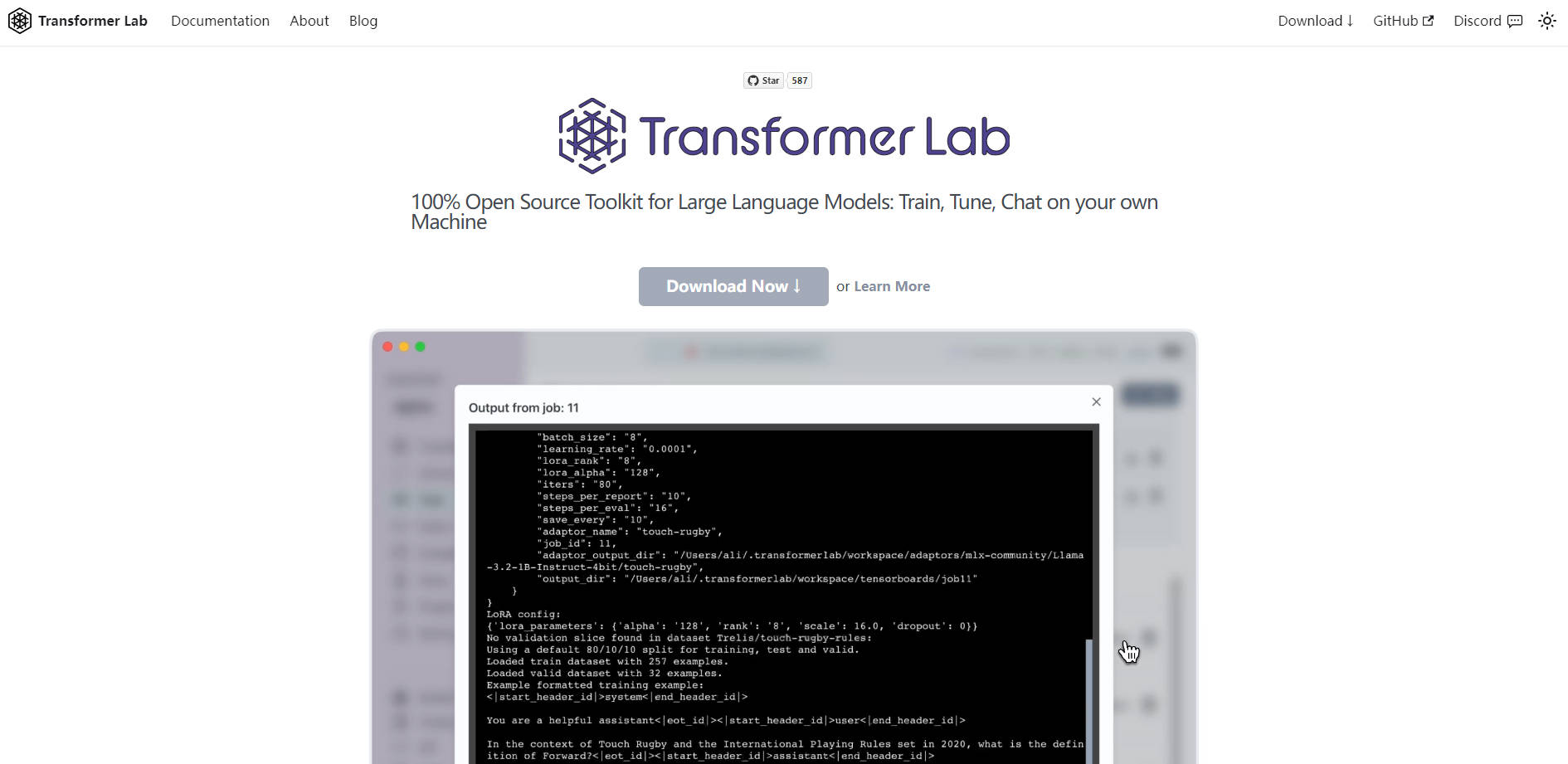

Transformer Lab es tu espacio de trabajo integral y de código abierto para la ingeniería avanzada de LLM. Ya seas investigador, desarrollador o entusiasta de la IA, esta herramienta gratuita te permite interactuar, entrenar, ajustar y evaluar modelos de lenguaje grandes (LLM) directamente en tu ordenador, sin suscripciones ni dependencias en la nube. Con soporte para GPUs, TPUs y Apple Silicon (M1, M2, M3), Transformer Lab está diseñado para ser accesible, flexible y potente.

Características Clave

? Acceso con un clic a cientos de modelos

Descarga y utiliza LLM populares como Llama3, Phi3, Mistral y Gemma con facilidad. También puedes obtener cualquier modelo de Huggingface, lo que te proporciona una flexibilidad sin igual.

? Ajusta y entrena en diferentes tipos de hardware

Ajusta modelos usando MLX en Apple Silicon o Huggingface en GPUs. Tanto si trabajas localmente como en la nube, Transformer Lab se adapta a tu configuración.

⚖️ Técnicas de entrenamiento avanzadas

Experimenta con RLHF (Aprendizaje por Refuerzo a partir de Retroalimentación Humana), DPO, ORPO y SIMPO para optimizar tus modelos para tareas específicas.

? Chat e inferencia interactiva

Chatea con los modelos, ajusta los parámetros de generación y utiliza la inferencia por lotes para realizar pruebas. Las indicaciones preestablecidas y el historial de chat hacen que la experimentación sea sencilla.

? Generación aumentada por recuperación (RAG)

Arrastra y suelta archivos para crear flujos de trabajo RAG, permitiendo que tus LLM interactúen con tus documentos. Funciona con MLX, Huggingface y otros motores.

? Evalúa y compara modelos

Prueba y compara modelos LLM para comprender su rendimiento y adecuación a tu caso de uso.

? Extensión con plugins

Personaliza Transformer Lab escribiendo tus propios plugins o utilizando los existentes. El editor de código Monaco integrado facilita la inmersión en los detalles.

¿Para quién es Transformer Lab?

Investigadores de IA: Experimenta con técnicas de entrenamiento de vanguardia como RLHF y optimización de preferencias.

Desarrolladores: Ajusta modelos para aplicaciones específicas e implémentalos en diferentes plataformas.

Entusiastas de la IA: Explora los LLM sin necesidad de costosos recursos en la nube.

Casos de Uso

Desarrollo de modelos personalizados

Ajusta un LLM para una tarea específica, como atención al cliente o generación de contenido, utilizando tu propio conjunto de datos.Interacción con documentos mediante RAG

Arrastra y suelta archivos PDF o de texto para crear un chatbot que responda preguntas basadas en tus documentos.Evaluación y comparación de modelos

Prueba múltiples LLM para encontrar el que mejor se adapte a tu aplicación, ya sea por velocidad, precisión o rentabilidad.

¿Por qué elegir Transformer Lab?

Gratuito y de código abierto: Sin costes ocultos ni suscripciones, solo descárgalo y empieza a utilizarlo.

Compatibilidad multiplataforma: Funciona en Windows, macOS y Linux, con soporte para Apple Silicon y GPUs.

Impulsado por la comunidad: Contribuye con plugins, únete a la comunidad de Discord y ayuda a dar forma al futuro de la herramienta.

¿Listo para empezar?

La mejor manera de aprender sobre Transformer Lab es sumergirse. Mira un vídeo tutorial completo, descarga la aplicación y comienza a experimentar con LLM en tus propios términos. Ya sea ajustando modelos, chateando con IA o creando conjuntos de datos personalizados, Transformer Lab pone el poder de la ingeniería avanzada de LLM en tus manos.

Preguntas Frecuentes

P: ¿Necesito una GPU para usar Transformer Lab?

R: Si bien una GPU o TPU mejora el rendimiento, Transformer Lab también funciona en Apple Silicon (M1, M2, M3) utilizando MLX.

P: ¿Puedo usar Transformer Lab en la nube?

R: ¡Sí! Puedes ejecutar la interfaz de usuario localmente mientras el motor se ejecuta en una máquina remota o en la nube.

P: ¿Es Transformer Lab fácil de usar para principiantes?

R: Absolutamente. Con descargas con un solo clic, indicaciones preestablecidas y funcionalidad de arrastrar y soltar, está diseñado para ser accesible para usuarios de todos los niveles de habilidad.

Transforma tu forma de trabajar con LLM. Descarga Transformer Lab hoy mismo y lleva tus proyectos de IA al siguiente nivel.

More information on Transformer Lab

Top 5 Countries

Traffic Sources

Transformer Lab Alternativas

Más Alternativas-

KTransformers, un proyecto de código abierto del equipo KVCache.AI de Tsinghua y QuJing Tech, optimiza la inferencia de modelos de lenguaje grandes. Reduce los umbrales de hardware, ejecuta modelos de 671B parámetros en GPUs individuales de 24GB de VRAM, aumenta la velocidad de inferencia (hasta 286 tokens/s en pre-procesamiento, 14 tokens/s en generación) y es adecuado para uso personal, empresarial y académico.

-

-

LM Studio es una aplicación de escritorio fácil de usar para experimentar con modelos de lenguaje grande (LLM) locales y de código abierto. La aplicación de escritorio multiplataforma LM Studio te permite descargar y ejecutar cualquier modelo compatible con ggml de Hugging Face, y proporciona una interfaz de usuario de configuración de modelos e inferencia simple pero poderosa. La aplicación aprovecha tu GPU cuando sea posible.

-

LLaMA Factory es un marco de ajuste fino de modelos grandes de código bajo de código abierto que integra las técnicas de ajuste fino ampliamente utilizadas en la industria y admite el ajuste fino de modelos grandes sin código a través de la interfaz de usuario web.

-

El proyecto LlamaEdge facilita la ejecución local de aplicaciones de inferencia LLM y la creación de servicios API compatibles con OpenAI para la serie Llama2 de LLMs.

![[dangao] [dangao]](/static/assets/comment/emotions/dangao.gif)

![[qiu] [qiu]](/static/assets/comment/emotions/qiu.gif)

![[fadou] [fadou]](/static/assets/comment/emotions/fadou.gif)

![[tiaopi] [tiaopi]](/static/assets/comment/emotions/tiaopi.gif)

![[fadai] [fadai]](/static/assets/comment/emotions/fadai.gif)

![[xinsui] [xinsui]](/static/assets/comment/emotions/xinsui.gif)

![[ruo] [ruo]](/static/assets/comment/emotions/ruo.gif)

![[jingkong] [jingkong]](/static/assets/comment/emotions/jingkong.gif)

![[quantou] [quantou]](/static/assets/comment/emotions/quantou.gif)

![[gangga] [gangga]](/static/assets/comment/emotions/gangga.gif)

![[da] [da]](/static/assets/comment/emotions/da.gif)

![[touxiao] [touxiao]](/static/assets/comment/emotions/touxiao.gif)

![[ciya] [ciya]](/static/assets/comment/emotions/ciya.gif)

![[liulei] [liulei]](/static/assets/comment/emotions/liulei.gif)

![[fendou] [fendou]](/static/assets/comment/emotions/fendou.gif)

![[kiss] [kiss]](/static/assets/comment/emotions/kiss.gif)

![[aoman] [aoman]](/static/assets/comment/emotions/aoman.gif)

![[kulou] [kulou]](/static/assets/comment/emotions/kulou.gif)

![[yueliang] [yueliang]](/static/assets/comment/emotions/yueliang.gif)

![[lenghan] [lenghan]](/static/assets/comment/emotions/lenghan.gif)

![[kun] [kun]](/static/assets/comment/emotions/kun.gif)

![[meng] [meng]](/static/assets/comment/emotions/meng.gif)

![[shenma] [shenma]](/static/assets/comment/emotions/shenma.gif)

![[peifu] [peifu]](/static/assets/comment/emotions/peifu.gif)

![[qinqin] [qinqin]](/static/assets/comment/emotions/qinqin.gif)

![[nanguo] [nanguo]](/static/assets/comment/emotions/nanguo.gif)

![[hufen] [hufen]](/static/assets/comment/emotions/hufen.gif)

![[shuai] [shuai]](/static/assets/comment/emotions/shuai.gif)

![[jingya] [jingya]](/static/assets/comment/emotions/jingya.gif)

![[cahan] [cahan]](/static/assets/comment/emotions/cahan.gif)

![[shengli] [shengli]](/static/assets/comment/emotions/shengli.gif)

![[qioudale] [qioudale]](/static/assets/comment/emotions/qioudale.gif)

![[cheer] [cheer]](/static/assets/comment/emotions/cheer.gif)

![[ketou] [ketou]](/static/assets/comment/emotions/ketou.gif)

![[shandian] [shandian]](/static/assets/comment/emotions/shandian.gif)

![[haqian] [haqian]](/static/assets/comment/emotions/haqian.gif)

![[jidong] [jidong]](/static/assets/comment/emotions/jidong.gif)

![[zaijian] [zaijian]](/static/assets/comment/emotions/zaijian.gif)

![[kafei] [kafei]](/static/assets/comment/emotions/kafei.gif)

![[love] [love]](/static/assets/comment/emotions/love.gif)

![[pizui] [pizui]](/static/assets/comment/emotions/pizui.gif)

![[huitou] [huitou]](/static/assets/comment/emotions/huitou.gif)

![[tiao] [tiao]](/static/assets/comment/emotions/tiao.gif)

![[liwu] [liwu]](/static/assets/comment/emotions/liwu.gif)

![[zhutou] [zhutou]](/static/assets/comment/emotions/zhutou.gif)

![[e] [e]](/static/assets/comment/emotions/e.gif)

![[qiang] [qiang]](/static/assets/comment/emotions/qiang.gif)

![[youtaiji] [youtaiji]](/static/assets/comment/emotions/youtaiji.gif)

![[zuohengheng] [zuohengheng]](/static/assets/comment/emotions/zuohengheng.gif)

![[huaixiao] [huaixiao]](/static/assets/comment/emotions/huaixiao.gif)

![[gouyin] [gouyin]](/static/assets/comment/emotions/gouyin.gif)

![[keai] [keai]](/static/assets/comment/emotions/keai.gif)

![[tiaosheng] [tiaosheng]](/static/assets/comment/emotions/tiaosheng.gif)

![[daku] [daku]](/static/assets/comment/emotions/daku.gif)

![[weiqu] [weiqu]](/static/assets/comment/emotions/weiqu.gif)

![[lanqiu] [lanqiu]](/static/assets/comment/emotions/lanqiu.gif)

![[zhemo] [zhemo]](/static/assets/comment/emotions/zhemo.gif)

![[xia] [xia]](/static/assets/comment/emotions/xia.gif)

![[fan] [fan]](/static/assets/comment/emotions/fan.gif)

![[yun] [yun]](/static/assets/comment/emotions/yun.gif)

![[youhengheng] [youhengheng]](/static/assets/comment/emotions/youhengheng.gif)

![[chong] [chong]](/static/assets/comment/emotions/chong.gif)

![[pijiu] [pijiu]](/static/assets/comment/emotions/pijiu.gif)

![[dajiao] [dajiao]](/static/assets/comment/emotions/dajiao.gif)

![[dao] [dao]](/static/assets/comment/emotions/dao.gif)

![[diaoxie] [diaoxie]](/static/assets/comment/emotions/diaoxie.gif)

![[liuhan] [liuhan]](/static/assets/comment/emotions/liuhan.gif)

![[haha] [haha]](/static/assets/comment/emotions/haha.gif)

![[xu] [xu]](/static/assets/comment/emotions/xu.gif)

![[zhuakuang] [zhuakuang]](/static/assets/comment/emotions/zhuakuang.gif)

![[zhuanquan] [zhuanquan]](/static/assets/comment/emotions/zhuanquan.gif)

![[no] [no]](/static/assets/comment/emotions/no.gif)

![[ok] [ok]](/static/assets/comment/emotions/ok.gif)

![[feiwen] [feiwen]](/static/assets/comment/emotions/feiwen.gif)

![[taiyang] [taiyang]](/static/assets/comment/emotions/taiyang.gif)

![[woshou] [woshou]](/static/assets/comment/emotions/woshou.gif)

![[zuqiu] [zuqiu]](/static/assets/comment/emotions/zuqiu.gif)

![[xigua] [xigua]](/static/assets/comment/emotions/xigua.gif)

![[hua] [hua]](/static/assets/comment/emotions/hua.gif)

![[tu] [tu]](/static/assets/comment/emotions/tu.gif)

![[tiaowu] [tiaowu]](/static/assets/comment/emotions/tiaowu.gif)

![[ma] [ma]](/static/assets/comment/emotions/ma.gif)

![[baiyan] [baiyan]](/static/assets/comment/emotions/baiyan.gif)

![[zhadan] [zhadan]](/static/assets/comment/emotions/zhadan.gif)

![[weixiao] [weixiao]](/static/assets/comment/emotions/weixiao.gif)

![[wen] [wen]](/static/assets/comment/emotions/wen.gif)

![[dabing] [dabing]](/static/assets/comment/emotions/dabing.gif)

![[xianwen] [xianwen]](/static/assets/comment/emotions/xianwen.gif)

![[shuijiao] [shuijiao]](/static/assets/comment/emotions/shuijiao.gif)

![[yongbao] [yongbao]](/static/assets/comment/emotions/yongbao.gif)

![[kelian] [kelian]](/static/assets/comment/emotions/kelian.gif)

![[pingpang] [pingpang]](/static/assets/comment/emotions/pingpang.gif)

![[danu] [danu]](/static/assets/comment/emotions/danu.gif)

![[geili] [geili]](/static/assets/comment/emotions/geili.gif)

![[wabi] [wabi]](/static/assets/comment/emotions/wabi.gif)

![[kuaikule] [kuaikule]](/static/assets/comment/emotions/kuaikule.gif)

![[zuotaiji] [zuotaiji]](/static/assets/comment/emotions/zuotaiji.gif)

![[tuzi] [tuzi]](/static/assets/comment/emotions/tuzi.gif)

![[bishi] [bishi]](/static/assets/comment/emotions/bishi.gif)

![[caidao] [caidao]](/static/assets/comment/emotions/caidao.gif)

![[dabian] [dabian]](/static/assets/comment/emotions/dabian.gif)

![[fanu] [fanu]](/static/assets/comment/emotions/fanu.gif)

![[guzhang] [guzhang]](/static/assets/comment/emotions/guzhang.gif)

![[se] [se]](/static/assets/comment/emotions/se.gif)

![[chajin] [chajin]](/static/assets/comment/emotions/chajin.gif)

![[bizui] [bizui]](/static/assets/comment/emotions/bizui.gif)

![[deyi] [deyi]](/static/assets/comment/emotions/deyi.gif)

![[ku] [ku]](/static/assets/comment/emotions/ku.gif)

![[huishou] [huishou]](/static/assets/comment/emotions/huishou.gif)

![[yinxian] [yinxian]](/static/assets/comment/emotions/yinxian.gif)

![[haixiu] [haixiu]](/static/assets/comment/emotions/haixiu.gif)