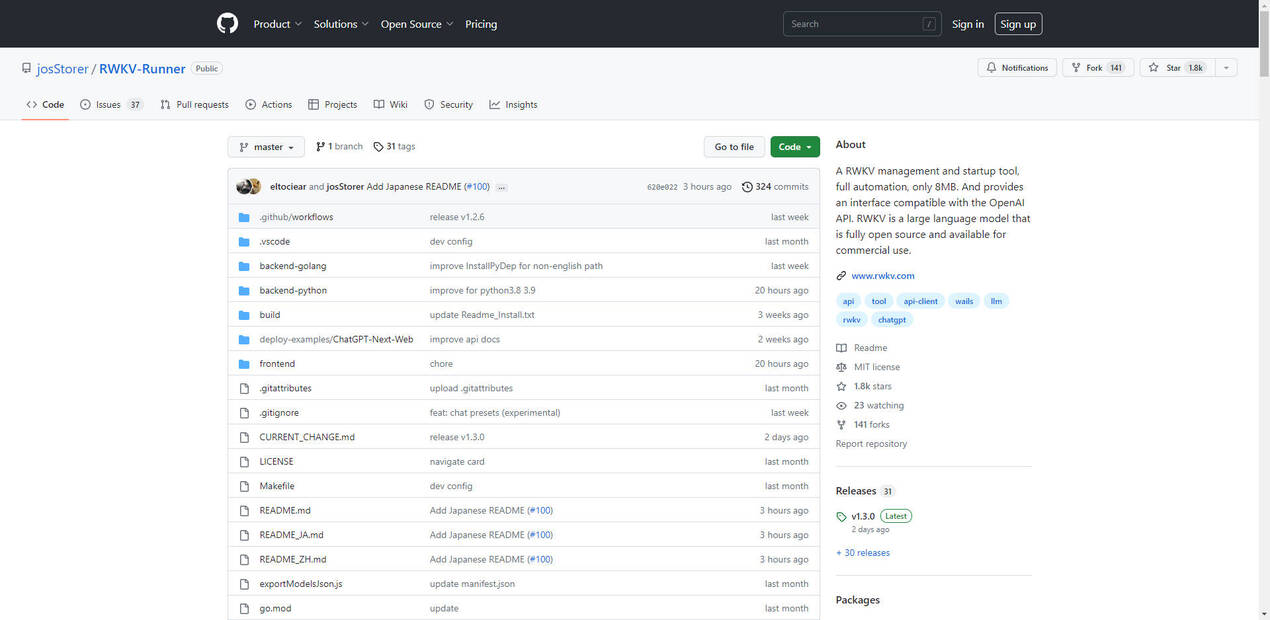

What is RWKV-Runner?

Инструмент управления и запуска RWKV — это лёгкое и полностью автоматизированное решение, призванное упростить развёртывание и эксплуатацию языковой модели RWKV. Веся всего 8 МБ, этот инструмент обеспечивает бесшовную интеграцию с API OpenAI, что делает его идеальным выбором для разработчиков и компаний, ищущих экономичную и высокопроизводительную альтернативу традиционным трансформерным моделям. RWKV сочетает в себе преимущества рекуррентных нейронных сетей (RNN) и трансформеров, обеспечивая быстрое вычисление, низкое потребление ресурсов и масштабируемость для любого контекста. RWKV, полностью открытый и доступный в коммерческом использовании, поддерживается активным сообществом и фондом Linux Foundation.

Основные возможности:

?️ Лёгкость и эффективность

Весом всего 8 МБ, инструмент обеспечивает минимальное потребление ресурсов при сохранении высокой производительности, что делает его подходящим для устройств с ограниченными аппаратными возможностями.? Совместимость с API OpenAI

Инструмент предоставляет интерфейс, который бесшовно интегрируется с API OpenAI, позволяя пользователям использовать возможности RWKV без переписывания существующих рабочих процессов.⚡ Быстрое вычисление и обучение

Архитектура RWKV сочетает в себе скорость RNN и производительность трансформеров, обеспечивая в 10–100 раз меньшие вычислительные требования по сравнению с традиционными моделями.? Масштабируемая длина контекста

В отличие от трансформеров, RWKV линейно масштабируется с длиной контекста, позволяя обрабатывать длинные тексты без снижения производительности.? Открытый исходный код и коммерчески дружелюбная лицензия

Лицензированный под Apache 2.0, RWKV свободно доступен как для личного, так и для коммерческого использования, поддерживаемый моделью разработки, управляемой сообществом.

Варианты использования:

AI-чат-боты

Разработчики могут использовать RWKV для создания чат-ботов с быстрым временем отклика и низким потреблением ресурсов, идеально подходящих для поддержки клиентов или интерактивных приложений.Генерация многоязычного контента

Высокая производительность RWKV в таких языках, как китайский и японский, делает его ценным инструментом для создания локализованного контента или перевода документов.Исследования и эксперименты

Исследователи могут использовать открытый исходный код RWKV и низкие вычислительные требования для экспериментов с собственными языковыми моделями или дообучения существующих для конкретных задач.

Заключение:

Инструмент управления и запуска RWKV — это революционное решение для разработчиков и компаний, стремящихся использовать возможности больших языковых моделей без больших затрат ресурсов, характерных для традиционных трансформеров. Его лёгкий дизайн, совместимость с API OpenAI и открытая лицензия делают его универсальным и экономичным решением для широкого спектра приложений. Независимо от того, создаёте ли вы чат-ботов, генерируете многоязычный контент или проводите исследования, RWKV обеспечивает необходимую производительность и гибкость.

More information on RWKV-Runner

-

Buggy at times, but overall performs well

-

Could have more documentation for beginners

-

Saves a lot of time for language model tasks

-

Limited features compared to similar software

-

Easy to install and setup, highly recommended

-

Not as intuitive as expected, but still useful

-

Efficient tool for automating language models

-

Great software, very user-friendly interface

RWKV-Runner Альтернативи

Больше Альтернативи-

ChatRWKV - это аналог ChatGPT, однако в его основе лежит языковая модель RWKV (100% RNN), при этом он является открытым исходным кодом.

-

RWKV — это рекуррентная нейронная сеть с производительностью LLM на уровне трансформатора. Ее можно обучать напрямую как GPT (параллельно). Таким образом, она объединяет в себе лучшее из РНС и трансформатора — отличную производительность, быстрый вывод, экономит VRAM, быстрое обучение, «бесконечную» длину контекста и бесплатную вставку предложений.

-

KTransformers – это open-source проект, разработанный командой KVCache.AI из Университета Цинхуа и компанией QuJing Tech, предназначенный для оптимизации логического вывода больших языковых моделей. Он снижает требования к аппаратному обеспечению, позволяя запускать модели с 671 миллиардом параметров на отдельных GPU с 24 ГБ VRAM, увеличивает скорость логического вывода (до 286 токенов/с на этапе предварительной обработки и 14 токенов/с на этапе генерации) и подходит для личного, корпоративного и академического использования.

-

MaxKB — мощная вопросно-ответная система, основанная на языковой модели LLM. Она обеспечивает бесшовную интеграцию и поддерживает несколько моделей для улучшенного интерактивного опыта.

-

Оцените Keywords AI — экономичное решение для высококачественных моделей ИИ. Технология LLM, созданная на основе GPT-4, оптимизирует запросы и сокращает расходы, не снижая эффективности. Высокая скорость ответа и нулевая задержка обеспечивают эффективность результатов при генерации контента, переводе языков и анализе данных. Выберите один из трех тарифных планов и начните с тарифного плана Starter для первоначального тестирования. Без скрытых платежей. Закажите демонстрацию или обратитесь в службу поддержки, чтобы получить помощь.

![[dangao] [dangao]](/static/assets/comment/emotions/dangao.gif)

![[qiu] [qiu]](/static/assets/comment/emotions/qiu.gif)

![[fadou] [fadou]](/static/assets/comment/emotions/fadou.gif)

![[tiaopi] [tiaopi]](/static/assets/comment/emotions/tiaopi.gif)

![[fadai] [fadai]](/static/assets/comment/emotions/fadai.gif)

![[xinsui] [xinsui]](/static/assets/comment/emotions/xinsui.gif)

![[ruo] [ruo]](/static/assets/comment/emotions/ruo.gif)

![[jingkong] [jingkong]](/static/assets/comment/emotions/jingkong.gif)

![[quantou] [quantou]](/static/assets/comment/emotions/quantou.gif)

![[gangga] [gangga]](/static/assets/comment/emotions/gangga.gif)

![[da] [da]](/static/assets/comment/emotions/da.gif)

![[touxiao] [touxiao]](/static/assets/comment/emotions/touxiao.gif)

![[ciya] [ciya]](/static/assets/comment/emotions/ciya.gif)

![[liulei] [liulei]](/static/assets/comment/emotions/liulei.gif)

![[fendou] [fendou]](/static/assets/comment/emotions/fendou.gif)

![[kiss] [kiss]](/static/assets/comment/emotions/kiss.gif)

![[aoman] [aoman]](/static/assets/comment/emotions/aoman.gif)

![[kulou] [kulou]](/static/assets/comment/emotions/kulou.gif)

![[yueliang] [yueliang]](/static/assets/comment/emotions/yueliang.gif)

![[lenghan] [lenghan]](/static/assets/comment/emotions/lenghan.gif)

![[kun] [kun]](/static/assets/comment/emotions/kun.gif)

![[meng] [meng]](/static/assets/comment/emotions/meng.gif)

![[shenma] [shenma]](/static/assets/comment/emotions/shenma.gif)

![[peifu] [peifu]](/static/assets/comment/emotions/peifu.gif)

![[qinqin] [qinqin]](/static/assets/comment/emotions/qinqin.gif)

![[nanguo] [nanguo]](/static/assets/comment/emotions/nanguo.gif)

![[hufen] [hufen]](/static/assets/comment/emotions/hufen.gif)

![[shuai] [shuai]](/static/assets/comment/emotions/shuai.gif)

![[jingya] [jingya]](/static/assets/comment/emotions/jingya.gif)

![[cahan] [cahan]](/static/assets/comment/emotions/cahan.gif)

![[shengli] [shengli]](/static/assets/comment/emotions/shengli.gif)

![[qioudale] [qioudale]](/static/assets/comment/emotions/qioudale.gif)

![[cheer] [cheer]](/static/assets/comment/emotions/cheer.gif)

![[ketou] [ketou]](/static/assets/comment/emotions/ketou.gif)

![[shandian] [shandian]](/static/assets/comment/emotions/shandian.gif)

![[haqian] [haqian]](/static/assets/comment/emotions/haqian.gif)

![[jidong] [jidong]](/static/assets/comment/emotions/jidong.gif)

![[zaijian] [zaijian]](/static/assets/comment/emotions/zaijian.gif)

![[kafei] [kafei]](/static/assets/comment/emotions/kafei.gif)

![[love] [love]](/static/assets/comment/emotions/love.gif)

![[pizui] [pizui]](/static/assets/comment/emotions/pizui.gif)

![[huitou] [huitou]](/static/assets/comment/emotions/huitou.gif)

![[tiao] [tiao]](/static/assets/comment/emotions/tiao.gif)

![[liwu] [liwu]](/static/assets/comment/emotions/liwu.gif)

![[zhutou] [zhutou]](/static/assets/comment/emotions/zhutou.gif)

![[e] [e]](/static/assets/comment/emotions/e.gif)

![[qiang] [qiang]](/static/assets/comment/emotions/qiang.gif)

![[youtaiji] [youtaiji]](/static/assets/comment/emotions/youtaiji.gif)

![[zuohengheng] [zuohengheng]](/static/assets/comment/emotions/zuohengheng.gif)

![[huaixiao] [huaixiao]](/static/assets/comment/emotions/huaixiao.gif)

![[gouyin] [gouyin]](/static/assets/comment/emotions/gouyin.gif)

![[keai] [keai]](/static/assets/comment/emotions/keai.gif)

![[tiaosheng] [tiaosheng]](/static/assets/comment/emotions/tiaosheng.gif)

![[daku] [daku]](/static/assets/comment/emotions/daku.gif)

![[weiqu] [weiqu]](/static/assets/comment/emotions/weiqu.gif)

![[lanqiu] [lanqiu]](/static/assets/comment/emotions/lanqiu.gif)

![[zhemo] [zhemo]](/static/assets/comment/emotions/zhemo.gif)

![[xia] [xia]](/static/assets/comment/emotions/xia.gif)

![[fan] [fan]](/static/assets/comment/emotions/fan.gif)

![[yun] [yun]](/static/assets/comment/emotions/yun.gif)

![[youhengheng] [youhengheng]](/static/assets/comment/emotions/youhengheng.gif)

![[chong] [chong]](/static/assets/comment/emotions/chong.gif)

![[pijiu] [pijiu]](/static/assets/comment/emotions/pijiu.gif)

![[dajiao] [dajiao]](/static/assets/comment/emotions/dajiao.gif)

![[dao] [dao]](/static/assets/comment/emotions/dao.gif)

![[diaoxie] [diaoxie]](/static/assets/comment/emotions/diaoxie.gif)

![[liuhan] [liuhan]](/static/assets/comment/emotions/liuhan.gif)

![[haha] [haha]](/static/assets/comment/emotions/haha.gif)

![[xu] [xu]](/static/assets/comment/emotions/xu.gif)

![[zhuakuang] [zhuakuang]](/static/assets/comment/emotions/zhuakuang.gif)

![[zhuanquan] [zhuanquan]](/static/assets/comment/emotions/zhuanquan.gif)

![[no] [no]](/static/assets/comment/emotions/no.gif)

![[ok] [ok]](/static/assets/comment/emotions/ok.gif)

![[feiwen] [feiwen]](/static/assets/comment/emotions/feiwen.gif)

![[taiyang] [taiyang]](/static/assets/comment/emotions/taiyang.gif)

![[woshou] [woshou]](/static/assets/comment/emotions/woshou.gif)

![[zuqiu] [zuqiu]](/static/assets/comment/emotions/zuqiu.gif)

![[xigua] [xigua]](/static/assets/comment/emotions/xigua.gif)

![[hua] [hua]](/static/assets/comment/emotions/hua.gif)

![[tu] [tu]](/static/assets/comment/emotions/tu.gif)

![[tiaowu] [tiaowu]](/static/assets/comment/emotions/tiaowu.gif)

![[ma] [ma]](/static/assets/comment/emotions/ma.gif)

![[baiyan] [baiyan]](/static/assets/comment/emotions/baiyan.gif)

![[zhadan] [zhadan]](/static/assets/comment/emotions/zhadan.gif)

![[weixiao] [weixiao]](/static/assets/comment/emotions/weixiao.gif)

![[wen] [wen]](/static/assets/comment/emotions/wen.gif)

![[dabing] [dabing]](/static/assets/comment/emotions/dabing.gif)

![[xianwen] [xianwen]](/static/assets/comment/emotions/xianwen.gif)

![[shuijiao] [shuijiao]](/static/assets/comment/emotions/shuijiao.gif)

![[yongbao] [yongbao]](/static/assets/comment/emotions/yongbao.gif)

![[kelian] [kelian]](/static/assets/comment/emotions/kelian.gif)

![[pingpang] [pingpang]](/static/assets/comment/emotions/pingpang.gif)

![[danu] [danu]](/static/assets/comment/emotions/danu.gif)

![[geili] [geili]](/static/assets/comment/emotions/geili.gif)

![[wabi] [wabi]](/static/assets/comment/emotions/wabi.gif)

![[kuaikule] [kuaikule]](/static/assets/comment/emotions/kuaikule.gif)

![[zuotaiji] [zuotaiji]](/static/assets/comment/emotions/zuotaiji.gif)

![[tuzi] [tuzi]](/static/assets/comment/emotions/tuzi.gif)

![[bishi] [bishi]](/static/assets/comment/emotions/bishi.gif)

![[caidao] [caidao]](/static/assets/comment/emotions/caidao.gif)

![[dabian] [dabian]](/static/assets/comment/emotions/dabian.gif)

![[fanu] [fanu]](/static/assets/comment/emotions/fanu.gif)

![[guzhang] [guzhang]](/static/assets/comment/emotions/guzhang.gif)

![[se] [se]](/static/assets/comment/emotions/se.gif)

![[chajin] [chajin]](/static/assets/comment/emotions/chajin.gif)

![[bizui] [bizui]](/static/assets/comment/emotions/bizui.gif)

![[deyi] [deyi]](/static/assets/comment/emotions/deyi.gif)

![[ku] [ku]](/static/assets/comment/emotions/ku.gif)

![[huishou] [huishou]](/static/assets/comment/emotions/huishou.gif)

![[yinxian] [yinxian]](/static/assets/comment/emotions/yinxian.gif)

![[haixiu] [haixiu]](/static/assets/comment/emotions/haixiu.gif)

Impressive performance, worth the investment